Згенероване майбутнє. Чим небезпечний штучний інтелект

Сьогодні люди по всьому світові активно цікавляться здобутками новітніх технологій, таких, як штучний інтелект (ШІ). Нещодавно компанія OpenAI надала безплатний доступ до свого чат-бота ChatGPT, що зробило цей інструмент доступним для безлічі інтернет-користувачів. Але чи є ця, здавалося б безпечна, акція такою насправді? Згідно з дослідженням аналітичного центру NewsGuard, які провели у січні 2023-го року, з’ясувалося, що популярний чат-бот ChatGPT може генерувати тексти, що розкручують вже наявні конспірологічні теорії та додають їх у контекст реальних подій. Також за допомогою цього бота можна генерувати дезінформаційні повідомлення. “Сєвєродонецьк онлайн” проаналізував, яку небезпеку несе новітній застосунок та як проти українців вже його використовує кремль.

Новітні технології загроза чи розвага

Нейромережі щоденно вдосконалюють свої навички зі створення різноманітного візуального та текстового контенту. Наразі більшість українців використовують їх переважно як іграшку, але водночас згенеровані ШІ матеріали не просто стають вірусними, а й часто сприймаються як реальні. Що ж в цьому шкідливого?

Ось цей візуал на фейсбуці за кілька днів набрав понад тисячу лайків і понад десять тисяч поширень.

“Авдіївка просить молитви” - згенерований малюнок, який більшість користувачів сприйняли за реальне фото. Попри явні “нестикування” - невідповідний однострій на військових, шеврон на рукаві дівчини та розіп’яту на хресті балерину. Але найнебезпечнішим у цьому дописі є саме психологічне навантаження — Авдіївку врятувати може лише вища сила, а не дії ЗСУ. Це деморалізує, примушує зневіритися та сіє панічні настрої.

Слід зазначити, що навіть малюнки штучного інтелекту, які використовують ілюстративно та без задуму нашкодити, можуть зіграти на руку ворогу.

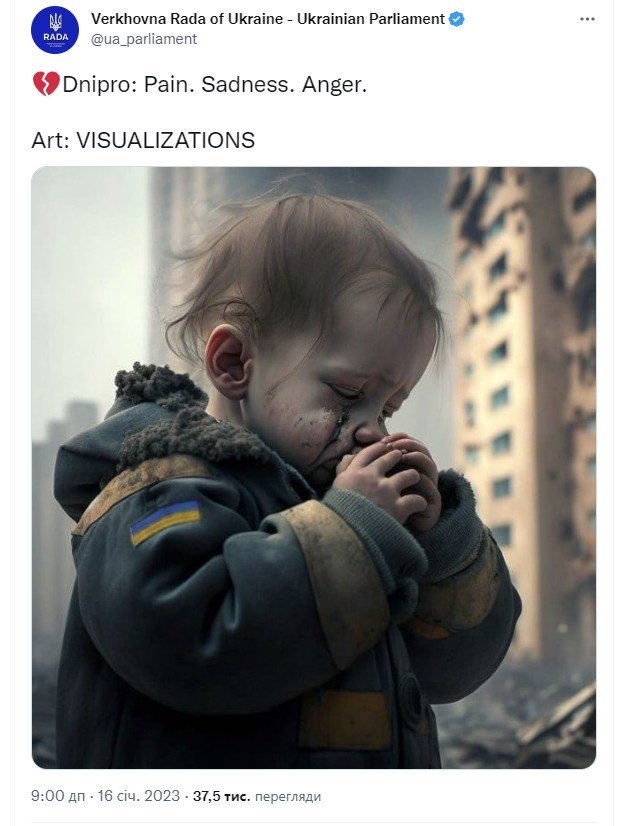

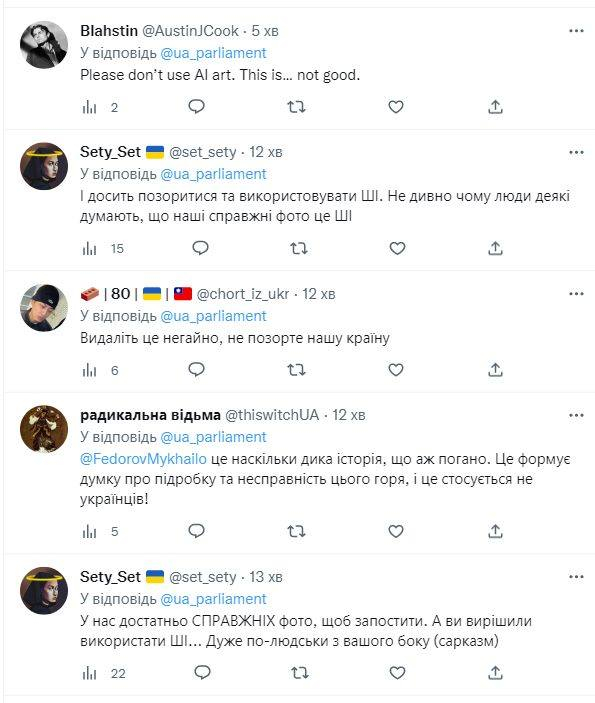

Цією згенерованою світлиною хлопчика SMM Верховної Ради України проілюстрували свій допис після влучання російської ракети у житловий будинок у Дніпрі. Допис опублікували о 9-й ранку 16 січня на офіційній англомовній сторінці ВР у твіттері.

"SMM-зашквар у твіттері Верховної Ради. Зробили твіт про Дніпро, проілюструвавши несправжнім фото "дитини", згенерованим штучним інтелектом. У коментарях — масове обурення (і я його розумію, бо така "комунікація" невчасна, шкідлива і шкідницька)"

Про це написала на своїй фейсбук-сторінці журналістка Олена Дуб.

У коментарях під дописом користувачі висловили своє обурення ілюстрацією та закликали її видалити. Щоправда, згодом твіт таки прибрали.

Читачі зазначили, що існує “достатньо справжніх фото”, щоб показати трагедію, що подібне зображення “формує думку про підробку й несправжність цього горя” і спонукає людей думати, що й справжні фото обстрілів теж є підробленими. Чому публікація та поширення таких штучних малюнків небезпечна? Вигаданий ШІ малюк нівелює російські злочини та страждання справжніх поранених дітей. Дає підстави ворогу звинувачувати Україну у брехні, мовляв, якщо вигадали цього хлопчика, то й решта жертв може бути фейками. Наведені приклади демонструють, що створені за допомогою нейромереж зображення вже конкурують із реальними. Вони викликають емоції, а це обов’язково буде використано рф з метою дезінформації.

Війна інтелектів

Український уряд ще у 2020-му році затвердив “Концепцію розвитку штучного інтелекту”. Документ визначає штучний інтелект як комп’ютерну програму, тож правове регулювання застосування ШІ дорівнює іншим програмним продуктам. Це свідчить про те, що чекати нормативно-правового регулювання ШІ поки що зарано.

Як повідомляють у Центрі стратегічних комунікацій та інформаційної безпеки:

”Розвиток ШІ випереджає створення запобіжників від його недоброчесного і зловмисного використання та формулювання політик щодо його регулювання. Тому співпраця українських урядових структур із Big Tech компаніями у напрямку протидії розповсюдженню дезінформації та виявлення й ліквідації ботоферм має лише поглиблюватись. У цьому зацікавлені як наша держава, так і світові технологічні гіганти”.

Тим часом на росії

Штучний інтелект щоденно створює контент, який все складніше верифікувати. ШІ допомагає генерувати фото-, аудіо- і відеофейки, а також стає потужним інструментом, який використовують у роботі так звані російські “ботоферми”. Замість людей, що пишуть коментарі за методичками, це може робити ШІ, адже він з легкістю створює контент з використанням ключових слів та запропонованої лексики.

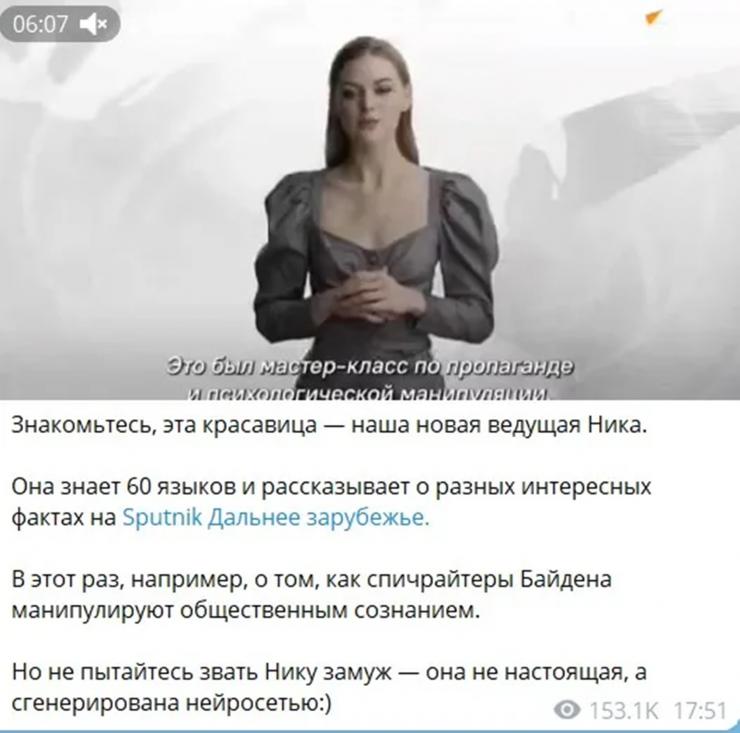

Як приклад, нещодавно Маргарита Симоньян анонсувала нову ведучу – “красуню Ніку, яка знає 60 мов і розповідає про різні цікаві факти на Sputnik Дальнее зарубежье”.

Але ще Стівен Гокінг попереджав : “Розвиток штучного інтелекту може означати кінець людської раси”.

Світ проти ШІ

В інтерв’ю Fox News CEO Tesla Ілон Маск поділився думками про штучний інтелект і вони наразі зовсім не оптимістичні.

“ШІ небезпечніший, ніж, скажімо, неправильне проєктування літаків, погане обслуговування виробництва або неякісний монтаж автомобілів, у тому сенсі, що він має потенціал, навіть якщо така ймовірність здається маленькою, вона дуже нетривіальна: потенціал зруйнувати цивілізацію”, — зазначив мільярдер у розмові з ведучим Fox News Такером Карлсоном.

Прокоментував Маск свої думки й у Twitter: «Кожен, хто думає, що цей ризик дорівнює 0%, — ідіот".

Навесні 2023-го року з’явився відкритий лист із закликом негайно призупинити створення “гігантських розумних систем” як “серйозних ризиків для суспільства і людства”. Його підписали понад тисяча науковців, дослідників та безпосередньо розробників штучного інтелекту.

Влітку 2022-го Google заборонив використовувати свій сервіс Colab для навчання моделей діпфейків. А цьогоріч анонсував “новий функціонал додаткового атрибутування зображень“ у своїй пошуковій системі. Це означає, що відтепер усі знайдені картинки отримуватимуть додатковий контекст про час індексування, а ШІ-зображення автоматично маркуватимуться.

“Сєвєродонецьк онлайн” нагадує: споживайте інформаційний контент відповідально!

- 2177 переглядів

Вибір редакції

Найсвіжіші новини:

- 19:00 Учасник захоплення будівлі СБУ в Луганську отримав 13 років тюрми

- 18:00 700 млн грн субвенції на облаштування житла для ВПО вже розподілили, – Мінсоцполітики

- 17:00 Передали до суду справу ексначальника колонії на Луганщині, де катували українських полонених

- 16:00 Окупанти на Луганщині створили «раду» для просування «традиційних цінностей»

- 15:00 Верховна Рада підтримала законопроєкт про базову соціальну допомогу

Найпопулярніші новини за тиждень:

- Сіверськодончанину Кирилу Ніжніку просять присвоїти звання Героя України (ПЕТИЦІЯ) 21.05.2026 переглядів: 4565

- Сіверськодонецька МВА призупинила діяльність закладів дошкільної освіти міста 22.05.2026 переглядів: 1102

- Офіс Сіверськодонецької МВА у Києві зруйнований після атаки рф, – Бойко 21.05.2026 переглядів: 905

- З російського полону повернувся рубіжанець Андрій Старіков 23.05.2026 переглядів: 827

Учасник захоплення будівлі СБУ в Луганську отримав 13 років тюрми

Учасник захоплення будівлі СБУ в Луганську отримав 13 років тюрми 700 млн грн субвенції на облаштування житла для ВПО вже розподілили, – Мінсоцполітики

700 млн грн субвенції на облаштування житла для ВПО вже розподілили, – Мінсоцполітики Передали до суду справу ексначальника колонії на Луганщині, де катували українських полонених

Передали до суду справу ексначальника колонії на Луганщині, де катували українських полонених